모티프테크놀로지스

모티프테크놀로지스인공지능(AI) 스타트업 모티프테크놀로지스가 자체 개발한 거대언어모델(LLM)인 'Motif 12.7B'를 허깅페이스에 오픈소스로 공개하며 프롬 스크래치(From scratch) 역량을 다시 한번 입증했다.

Motif 12.7B는 앞서 공개했던 경량 모델(Motif 2.6B)에서 한 단계 도약한 고성능 LLM으로 추론 능력과 학습 효율 모두를 단 7주만에 혁신적으로 끌어올렸다.

127억개의 매개변수(파라미터)를 기반으로 하는 이 모델은 모티프테크놀로지스가 모델 구축부터 데이터 학습까지 전 과정을 직접 수행한 순수 국산 기술이다. 지난 7월 T2I(Text to Image) 모델인 'Motif-Image-6B'를 공개한 모티프테크놀로지스는 현재 국내 유일하게 LLM과 거대멀티모달모델(LMM)을 모두 독자 개발하는 역량을 보유했다.

모티프테크놀로지스는 독자 개발·고안한 '그룹 단위 차등 어텐션(Grouped Differential Attention)'과 '뮤온 옵티마이저(Muon Optimizer) 병렬화 알고리즘'이라는 두 가지 LLM 개발 기술을 통해, 모델 성능과 학습 효율의 혁신적 향상을 이뤘다.

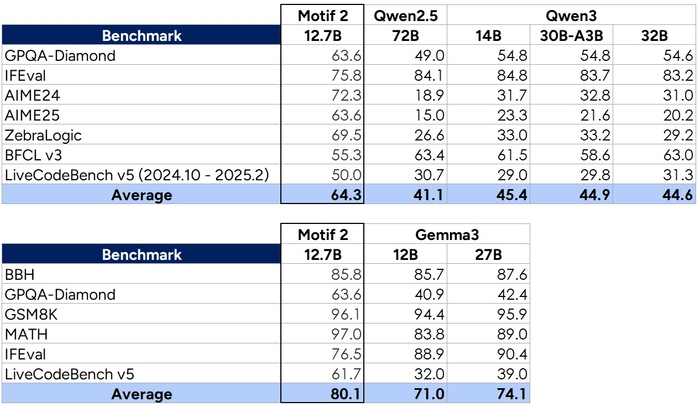

벤치마크 결과 Motif 12.7B는 'AIME25', 'GPQA-Diamond', '지브라로직(ZebraLogic)' 등 추론 능력을 평가하는 수학, 과학, 논리 과제에서 720억 매개변수를 가진 알리바바 큐원 2.5(72B)을 능가했다. 구글 젬마3 동급 모델과의 비교에서도 주요 추론 능력 관련 평가 지표에서 더 나은 점수를 얻었다.

벤치마크 결과. 자료= 모티프테크놀로지스

벤치마크 결과. 자료= 모티프테크놀로지스개발 단계에서는 강화학습 과정이 생략돼 고비용 학습 부담을 크게 줄였다. 또 운영 단계에서는 모델이 불필요한 추론 연산을 자동으로 회피함으로써 그래픽처리장치(GPU) 사용량 절감, 모델 관리의 단순화, 응답 지연시간 최소화 등 실질적 효율 개선을 달성했다.

임정환 모티프테크놀로지스 대표는 “GDA와 뮤온 옵티마이저 병렬화 알고리즘은 각각 LLM의 '두뇌'와 '에너지 효율'을 혁신적으로 재설계한 기술”이라며 “이 기술로 완성한 Motif 12.7B는 단순한 성능 향상을 넘어 AI 모델의 구조적 진화를 보여주는 사례가 됨과 동시에 보다 비용 효율적인 고성능 LLM을 원하는 기업들에게 모범 답안이 될 것”이라고 밝혔다.

김명희 기자 noprint@etnews.com

4 days ago

1

4 days ago

1

![[ET단상] 대한민국 혁신 벤처기업의 현실과 미래비전](https://img.etnews.com/news/article/2025/10/14/news-p.v1.20251014.0aaad6b4c50a48438f5879e07dd95fb3_P3.jpg)

![[포토] 인공지능 솔루션으로 수능 모의지원](https://img.etnews.com/news/article/2025/11/07/news-p.v1.20251107.c15dbf721c0b420aa8c75e30ecb3a2ef_P1.jpg)

![닷컴 버블의 교훈[김학균의 투자레슨]](https://www.edaily.co.kr/profile_edaily_512.png)

English (US) ·

English (US) ·