- 현재의 대형 언어 모델은 규모 확장 한계에 부딪혀 있으며, AGI는 더 큰 모델이 아닌 시스템 아키텍처 설계로 접근해야 함

- 진정한 AGI는 맥락 관리, 지속적 메모리, 결정적 워크플로우, 특화 모델 협업 등 다양한 구성 요소가 유기적으로 결합된 엔지니어링 성과로 만들어져야 함

- LLM은 여전히 세션 간 맥락 유지 부족, 신뢰성 있는 다단계 추론 부재, 기억 부재 같은 구조적 한계를 안고 있음

- AGI 달성을 위해서는 인간 두뇌처럼 각각 목적이 분명한 모듈형 구조 및 분산 시스템적 접근, 즉 오류 허용 파이프라인, 모니터링, 롤링 업데이트, 대규모 테스트 프레임워크 같은 인프라 구축이 필요함

- 따라서 AGI 경쟁은 GPU 규모가 아니라 시스템 엔지니어링 역량에 의해 좌우될 것

서론: AGI는 엔지니어링 문제임

- AI 분야에서 스케일링 법칙의 한계가 드러나고 있음

- GPT-5, Claude, Gemini 등 최고의 모델들도 점점 수확 체감을 보이고 있음

- 언어 모델의 크기 증가는 근본적인 한계에 부딪혔고, AGI는 모델 훈련이 아닌, 시스템 엔지니어링을 통해 실현될 수 있음

현실적인 한계: LLM의 벽

- 현세대 대형 언어 모델(LLM) 은 일시적인 패턴 매칭과 텍스트 생성에는 강점을 보이지만, 다음과 같은 본질적 한계를 가짐

-

일관된 컨텍스트 유지 불가

- 장기적, 세션 간 영속적 기억 부재

-

복잡한 다단계 추론에서 신뢰성 낮음

- 과거 반도체 산업에서도 비슷한 현상을 겪었으며, 구조적 전환(멀티코어 등) 이 해법이었음

- AI에도 아키텍처적 재설계가 필요해짐

AGI를 위한 시스템적 접근

- 인간의 뇌는 단일 신경망이 아닌 여러 특화된, 협력적 시스템의 집합임

- 기억, 컨텍스트, 논리, 공간, 언어 등 비동기적 피드백 루프가 핵심임

- 진정한 AGI는 이러한 복합 시스템 설계가 필수임

1. 컨텍스트 관리 인프라

- 현재 모델의 컨텍스트 이해는 수천 토큰에 불과하지만, 인간은 수년치 경험을 종합함

- GAP 극복을 위해 아래 기능이 필요함

-

즉시 검색 및 필터 역할의 고도화된 정보 Retrieval 시스템

-

영속적 세계 모델 축적 및 진화

-

도메인 간 컨텍스트 브릿지 구현

-

상충 정보 관리(확률 가중 및 불확실성 계량)

-

운용 가능한 지식 그래프가 필요하며, 이는 단순 벡터 검색을 넘어 역동적 질의·추론 구조임

2. 서비스화된 메모리

- LLM은 실제 기억 없이 프롬프트 조작으로만 일시적 기억을 재현함

- 실제 AGI는 다음이 가능한 시스템이 요구됨

-

지식 신뢰도 조정(새 증거 반영)

- 다양한 경험 간 정보 통합 및 일반화

-

불필요한 세부 정보 망각(치명적 잊힘 없이)

- 출처 추정, 신뢰도 등 메타지식 생성

- 인간 기억처럼, 사용 빈도에 따라 강화·약화되고 새로운 정보로 재조직됨이 중요함

3. 결정적 워크플로우와 확률적 컴포넌트의 결합

- AGI의 핵심은 결정적 플로우에 확률적 요소가 적재적소에 결합되는 하이브리드 구조임

- Ex) 컴파일러처럼 전체 흐름은 고정, 내부 과정은 휴리스틱 활용

- 필요한 능력:

-

문제 특성에 따라 전문 솔버로 라우팅

- 다단계 워크플로우에서 롤백·복구 지원

-

확률적 결과에 대한 결정적 검증

-

다양한 컴포넌트 조합 및 예측 가능성 확보

- 모호성·불확실성을 아키텍처 차원에서 핵심 요소로 수용해야 함

4. 전문화 모델의 모듈화

- 미래는 단일 거대 모델이 아닌, 수많은 특화 모델의 협력으로 구현됨

- LLM은 언어 작업이 강점이나 다음 영역에 약함

- 심볼 조작·정확 계산

- 시각·공간 추론

- 시간 추론·계획

- 지속적 목표 지향 에이전트 행동

- 해결책:

- 각 도메인에 최적화된 전문 모델로 문제 라우팅

-

결과 통합 및 독립 진화 구조

-

개별 실패 시 전체 시스템 연쇄 오류 방지

AGI의 엔지니어링 과제

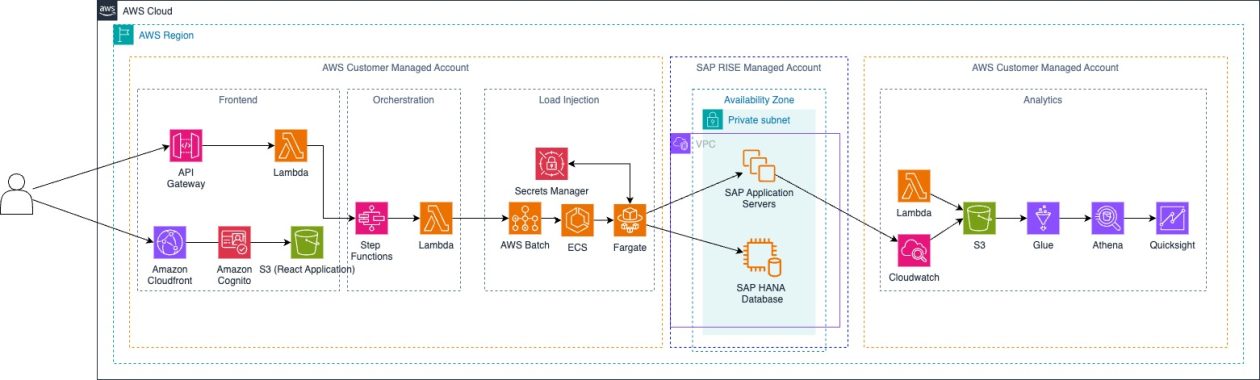

- AGI 개발은 본질적으로 분산시스템 구축의 문제임

- 핵심적 엔지니어링 과제:

-

결함 복원성 파이프라인 (부분 실패에도 전체 운영 유지)

-

모델 출력 관측 및 모니터링 구조

-

변경·배포의 무중단화

- 수천가지 모델 조합·파라미터 변화시 테스트 프레임워크

- 이는 인공지능 전문가보다 인프라, 분산시스템 엔지니어의 숙련 지식이 더 필수적임

앞으로 우리가 구축해야 할 것

- 모델 사이즈 경쟁보다 AGI 인프라 구축에 초점을 맞춰야 함

Phase 1: 기본 계층

-

Context Management Service : 실시간 업데이트, 버전 관리된 지속적 지식 그래프

-

Memory Service : 에피소드, 의미 기반 메모리, 학습기반 통합

-

Workflow Engine : 확률성 부품을 결정적으로 오케스트레이션 (롤백 포함)

-

Agent Coordination Layer : 다중 에이전트 간 합의, 갈등 해결

Phase 2: 능력 계층

-

전문화 모델 컨트롤 : 특정 추론 도메인별 표준화 인터페이스

-

Symbolic Reasoning Engine : 확률 컴포넌트와 연동되는 심볼 조작·계산

-

Planning and Goal Management : 복잡 목표를 실행 가능 계획으로 분할

-

Cross-modal Integration : 텍스트, 비전, 오디오 등 센싱 정보 통합

Phase 3: 창발 계층

- 여러 컴포넌트 상호작용에서 창발적 AGI 능력이 발생함

- 체계적 설계 없이 단일 모델 발전만으로는 창발 특성 부재

AGI를 향한 길

- AGI 실현 경로는 더 크고 새로운 트랜스포머 훈련이 아니라, 수백 개 전문 모델을 분산시스템적으로 오케스트레이션하는 인프라 구축임

-

분산 시스템 구축 경험이 풍부한 인프라 엔지니어가 개발의 핵심임

-

컨텍스트 경로, 메모리, 워크플로우 자동화, 모델 조율 등 대규모 구현력 강조

-

대형 GPU 클러스터 보유보다 신뢰도 높고 논리적으로 동작하는 아키텍처 역량 보유팀이 AGI 실현의 승리자임을 단언함

- 모델 역량 자체는 이미 충분하며, 시스템 엔지니어링이 AGI 완성의 마지막 퍼즐임

- 결론적으로 알고리듬 혁신보다 구조적 설계(아키텍처)가 AGI의 미래임을 선언함

1 day ago

1

1 day ago

1

English (US) ·

English (US) ·